【BigQuery/Terraform】セキュア構築×開発プロセスAI化推進案件

時給 5,300円 ~ 6,250円

雇用形態: 業務委託

勤務地:

BigQuery

の転職・求人情報

1~20件(409件)

時給 5,300円 ~ 6,250円

雇用形態: 業務委託

勤務地:

年収 550万円 ~ 750万円

雇用形態: 正社員

勤務地:

年収 600万円 ~ 900万円

雇用形態: 正社員

勤務地:

年収 500万円 ~ 700万円

雇用形態: 正社員

勤務地:

時給 5,000円 ~ 6,250円

雇用形態: 業務委託

勤務地:

時給 3,100円 ~ 5,600円

雇用形態: 業務委託

勤務地:

年収 450万円 ~ 650万円

雇用形態: 正社員

勤務地:

時給 4,150円 ~ 6,250円

雇用形態: 業務委託

勤務地:

年収 600万円 ~ 810万円

雇用形態: 正社員

勤務地:

年収 600万円 ~ 810万円

雇用形態: 正社員

勤務地:

時給 4,150円 ~ 6,250円

雇用形態: 業務委託

勤務地:

年収 700万円 ~ 1,200万円

雇用形態: 正社員

勤務地:

年収 1,000万円 ~ 2,000万円

雇用形態: 正社員

勤務地:

年収 600万円 ~ 1,000万円

雇用形態: 正社員

勤務地:

年収 750万円 ~ 1,300万円

雇用形態: 正社員

勤務地:

年収 600万円 ~ 1,500万円

雇用形態: 正社員

勤務地:

年収 700万円 ~ 1,100万円

雇用形態: 正社員

勤務地:

時給 4,000円 ~ 6,000円

雇用形態: 業務委託

勤務地:

年収 420万円 ~ 600万円

雇用形態: 正社員

勤務地:

年収 650万円 ~ 850万円

雇用形態: 正社員

勤務地:

アカウントを作成して、求人情報のブックマークや応募の管理ができます。

求人に関するサマリ

BigQueryは、Googleが提供する強力なクラウドデータウェアハウスサービスです。大規模なデータセットを高速に分析し、複雑なクエリを実行できる能力を持っています。従来のデータベースシステムとは異なり、BigQueryはサーバーレスアーキテクチャを採用しているため、インフラストラクチャの管理に煩わされることなく、データ分析に集中できるのが特徴です。

このサービスは、ペタバイト規模のデータを数秒で処理できる圧倒的なパフォーマンスを誇ります。そのため、企業や組織が持つ膨大なデータから迅速に洞察を得ることが可能となり、ビジネス上の意思決定をデータドリブンに行うことをサポートします。BigQueryの登場により、データ分析の世界は大きく変わったと言えるでしょう。

BigQueryの基本的な仕組みは、データを列指向のストレージに保存し、分散処理システムを使って並列にクエリを実行することにあります。これにより、従来のRDBMSでは難しかった大規模データの高速分析が実現しています。データサイエンティストやアナリストにとって、BigQueryは強力な武器となっているのです。

BigQueryの主要な特徴には、以下のようなものがあります。まず、スケーラビリティが挙げられます。数テラバイトから数ペタバイトまで、データ量に応じて自動的にスケールアップするため、ユーザーは規模を気にすることなくデータ分析に専念できます。

次に、高速性です。BigQueryは、GoogleのColossusファイルシステムとBorgクラスタ管理システムを基盤としているため、驚異的な処理速度を実現しています。例えば、1兆行のデータに対するクエリを数秒で処理することも可能です。

さらに、使いやすさも大きな特徴です。SQLライクな言語であるStandardSQLをサポートしているため、SQLに慣れた開発者やアナリストであれば、すぐに使いこなすことができます。また、WebUIやCLI、各種プログラミング言語用のクライアントライブラリなど、多様なインターフェースを提供しているのも魅力的です。

BigQueryを利用するには、まずGoogle Cloudアカウントが必要です。アカウント作成は比較的簡単で、クレジットカード情報を入力するだけで完了します。新規ユーザーには300ドル相当の無料クレジットが提供されるため、初期段階での実験的な利用にも適しています。

アカウント作成後は、Google Cloud Consoleにアクセスし、BigQueryを有効化する必要があります。これにより、BigQueryの機能を全て利用できるようになります。プロジェクトの作成も忘れずに行いましょう。プロジェクトは、リソースやAPIの論理的なグループとして機能します。

なお、Google Cloudアカウントの作成時には、セキュリティに十分注意を払う必要があります。多要素認証を設定し、定期的にパスワードを変更するなど、基本的なセキュリティ対策を怠らないようにしましょう。BigQueryで扱うデータは貴重な資産ですから、アカウントの管理は慎重に行うべきです。

BigQueryコンソールは、Webブラウザを通じてBigQueryを操作するためのインターフェースです。ここでは、データセットの作成、テーブルの管理、クエリの実行など、BigQueryの主要な操作を全て行うことができます。コンソールの使い方に慣れることで、BigQueryの機能を最大限に活用できるようになります。

コンソールの左側にはナビゲーションメニューがあり、プロジェクト、データセット、テーブルなどの階層構造を簡単に把握できます。中央部分はクエリエディタとなっており、ここでSQLクエリを記述し実行することができます。また、右側には実行結果や詳細情報が表示されます。

BigQueryコンソールの特筆すべき機能の一つに、クエリの自動補完があります。これにより、テーブル名やカラム名を正確に覚えていなくても、効率的にクエリを作成することができます。また、クエリの実行計画を視覚化する機能も備えており、パフォーマンスのボトルネックを特定するのに役立ちます。

コマンドラインインターフェース(CLI)を使用してBigQueryを操作することも可能です。これは、自動化やスクリプト作成、バッチ処理などに適しています。Google Cloud SDKをインストールすることで、「bq」コマンドを使ってBigQueryの様々な操作を行えるようになります。

例えば、「bq query」コマンドを使用すれば、コマンドラインから直接SQLクエリを実行できます。「bq load」コマンドでデータのロードを、「bq extract」コマンドでデータのエクスポートを行うことができます。これらのコマンドは、パイプラインの構築やバッチ処理の自動化に非常に有用です。

CLIの利点は、操作の再現性が高いことです。実行したコマンドを記録しておけば、同じ操作を何度でも正確に再現できます。また、シェルスクリプトと組み合わせることで、複雑なデータ処理フローを自動化することも可能です。BigQueryを本格的に活用する上で、CLIの使い方を習得することは大きな武器となるでしょう。

BigQueryは豊富なAPIを提供しており、様々なプログラミング言語からBigQueryの機能にアクセスすることができます。これにより、既存のアプリケーションにBigQueryの分析機能を組み込んだり、カスタムのデータパイプラインを構築したりすることが可能になります。

Googleは主要なプログラミング言語向けにクライアントライブラリを提供しています。例えば、Python、Java、Go、Node.js、Ruby、PHP、C#などがサポートされています。これらのライブラリを使用することで、APIの低レベルな詳細を気にすることなく、BigQueryの機能を簡単に利用できます。

APIとクライアントライブラリを活用することで、BigQueryをより柔軟に、より深く活用することができます。例えば、リアルタイムデータ分析システムの構築や、機械学習モデルとBigQueryを組み合わせた予測分析など、高度なデータ活用が可能になります。ただし、APIの利用にはクォータやレート制限があるため、それらを考慮したアプリケーション設計が必要です。

BigQueryにおいて、データセットは最上位の組織単位です。これは従来のデータベース管理システムにおけるスキーマに相当します。データセットは、テーブルやビューなどのオブジェクトをグループ化し、アクセス制御の単位としても機能します。

データセットの作成時には、地理的な位置を指定する必要があります。これにより、データの保存場所を制御し、データの主権やコンプライアンスの要件を満たすことができます。例えば、EUのGDPR規制に対応するため、データをEU圏内に保存するといった対応が可能です。

また、データセットレベルでのアクセス制御も重要な機能です。特定のユーザーやグループに対して、データセット全体へのアクセス権限を付与したり、制限したりすることができます。これにより、セキュリティとデータガバナンスを効果的に管理することが可能になります。

テーブルは、BigQueryにおけるデータ保存の基本単位です。各テーブルは行と列で構成され、スキーマによってその構造が定義されます。BigQueryは、構造化データだけでなく、半構造化データ(JSONやAvroなど)も扱うことができ、これにより柔軟なデータモデリングが可能になっています。

BigQueryのテーブルには、通常のテーブルの他に、外部テーブルという概念も存在します。外部テーブルは、BigQuery外部のストレージ(例えばCloud Storage)に保存されているデータを参照するテーブルです。これにより、データを移動させることなく分析を行うことができます。

テーブルの管理においては、パーティショニングとクラスタリングという概念が重要です。パーティショニングは、特定のカラムに基づいてデータを物理的に分割する機能で、大規模なテーブルのクエリパフォーマンスを向上させます。クラスタリングは、関連するデータを物理的に近接して配置する機能で、特定の条件でのデータ検索を高速化します。

ビューは、SQLクエリの結果を仮想的なテーブルとして定義したものです。実際のデータは保存せず、クエリ定義だけを保持します。ビューは、複雑なクエリをシンプル化したり、データのサブセットにアクセスを制限したりする場合に非常に有用です。

BigQueryのビューは、セキュリティの観点からも重要な役割を果たします。例えば、センシティブな情報を含むカラムを除外したビューを作成し、特定のユーザーグループにはそのビューへのアクセスのみを許可するといった使い方が可能です。これにより、必要最小限の情報へのアクセスを実現し、データのセキュリティを強化できます。

また、ビューを活用することで、データモデルの抽象化やレポーティングの標準化も実現できます。共通で使用される複雑な集計ロジックをビューとして定義しておけば、それを基にした分析やレポート作成が容易になります。ビューの適切な活用は、BigQueryを使ったデータ分析の効率を大きく向上させる鍵となります。

マテリアライズド・ビューは、通常のビューと異なり、クエリ結果を物理的に保存する機能です。これにより、頻繁に実行される複雑なクエリの結果をキャッシュし、パフォーマンスを大幅に向上させることができます。BigQueryは自動的にマテリアライズド・ビューを最新の状態に保つため、ユーザーは常に最新のデータにアクセスできます。

マテリアライズド・ビューの利用は、特に大規模なデータセットに対する集計や結合操作を含むクエリで効果を発揮します。例えば、日次の売上集計など、定期的に実行される重い処理をマテリアライズド・ビューとして定義しておけば、クエリ実行時間を大幅に短縮できます。

ただし、マテリアライズド・ビューには追加のストレージコストがかかるため、使用する際はコストとパフォーマンスのバランスを考慮する必要があります。また、全てのクエリでマテリアライズド・ビューが使用できるわけではなく、一定の制約があることにも注意が必要です。適切な使用シナリオを見極めることが、効果的な活用のポイントとなります。

BigQueryは、ルーティンと呼ばれる再利用可能なコード単位をサポートしています。これには、ストアド・プロシージャ、ユーザー定義関数(UDF)、テーブル関数が含まれます。これらの機能を活用することで、複雑なロジックをカプセル化し、クエリの可読性と再利用性を高めることができます。

ユーザー定義関数(UDF)は、SQLやJavaScriptで記述できる関数で、クエリ内で使用することができます。例えば、複雑な計算ロジックや文字列操作をUDFとして定義しておけば、それを様々なクエリで再利用できます。これにより、コードの重複を避け、メンテナンス性を向上させることができます。

テーブル関数は、テーブルを返す関数で、FROM句で使用することができます。これにより、動的なデータ生成や複雑なデータ変換処理をクエリの一部として実行することが可能になります。BigQueryのこれらの機能を適切に活用することで、より柔軟で効率的なデータ処理を実現できるのです。

BigQueryにおけるジョブは、長時間実行される可能性のある操作を管理するための仕組みです。主なジョブタイプには、クエリジョブ、ロードジョブ、エクスポートジョブ、コピージョブなどがあります。これらのジョブは非同期で実行され、その進行状況や結果を後から確認することができます。

例えば、大規模なデータセットに対するクエリを実行する場合、即時に結果が返ってこない可能性があります。このような場合、クエリジョブとして実行することで、バックグラウンドで処理を進めながら、他の作業を続けることができます。ジョブIDを使って後からジョブの状態を確認し、完了後に結果を取得することが可能です。

また、BigQueryは自動的にジョブの履歴を保持します。これにより、過去に実行したジョブの詳細(実行時間、処理されたデータ量など)を確認することができ、パフォーマンスチューニングやコスト最適化に役立てることができます。ジョブ管理機能を適切に活用することで、BigQueryの運用効率を大幅に向上させることが可能となります。

バッチロードは、大量のデータをBigQueryに一括で取り込む方法です。これは、定期的なデータ更新や初期データロードなどのシナリオで特に有用です。BigQueryは、CSV、JSON、Avro、Parquetなど、多様なファイル形式をサポートしているため、既存のデータをほぼそのまま取り込むことができます。

バッチロードの実行方法は複数あります。BigQueryコンソールからのGUIベースの操作、「bq load」コマンドを使用したCLIからの操作、そしてクライアントライブラリを使用したプログラムからの操作などが可能です。大規模なデータセットの場合、Cloud Storageを経由してデータをロードするのが一般的です。これにより、ネットワークの切断などの問題に対する耐性が向上します。

バッチロード時には、スキーマの自動検出機能を利用することもできます。これにより、データファイルの内容からBigQueryが自動的にスキーマを推論し、テーブルを作成します。ただし、より厳密なデータ制御が必要な場合は、明示的にスキーマを定義することをお勧めします。適切なバッチロード戦略を立てることで、BigQueryへのデータ取り込みを効率的に行うことができます。

ストリーミングデータのロードは、リアルタイムでデータをBigQueryに取り込む方法です。これにより、データが生成されるとほぼ同時に分析可能になるため、リアルタイム分析やリアルタイムダッシュボードの構築などに非常に有効です。BigQueryのストリーミング挿入APIを使用することで、1秒あたり最大100,000行のデータを取り込むことができます。

ストリーミングデータのロードは、主にプログラムから行います。Pythonや Java、Go言語などのクライアントライブラリを使用して、アプリケーションからBigQueryにデータをストリーミングできます。また、Google Cloud PubSubと組み合わせることで、より堅牢なストリーミングデータパイプラインを構築することも可能です。

ただし、ストリーミングデータのロードにはいくつかの注意点があります。まず、コストが比較的高くなる傾向があります。また、ストリーミングで挿入されたデータは、バッファに保存されてから実際のテーブルに書き込まれるため、クエリ結果に即時反映されない場合があります。これらの特性を理解した上で、適切なユースケースでストリーミングデータのロードを活用することが重要です。

BigQueryでは、GoogleSQLと呼ばれるSQL方言を使用してデータの分析とクエリを行います。GoogleSQLは、ANSI SQL 2011規格に準拠しており、多くのSQLユーザーにとって馴染みやすい言語です。同時に、BigQuery特有の機能や最適化のための拡張も含まれています。

GoogleSQLの特徴的な機能の一つに、ARRAYやSTRUCT型のサポートがあります。これらを使用することで、複雑なデータ構造を効率的に扱うことができます。また、ウィンドウ関数やANALYTIC関数など、高度な分析に必要な機能も豊富に用意されています。これらの機能を駆使することで、複雑なビジネスロジックを単一のSQLクエリで表現することが可能になります。

BigQueryでは、テラバイトやペタバイト規模のデータに対しても高速にクエリを実行できます。この背景には、BigQueryの分散処理アーキテクチャがあります。ユーザーは複雑なクラスタ管理を意識する必要はなく、シンプルにSQLを記述するだけで、大規模データの高速分析が可能になるのです。ただし、効率的なクエリ実行のためには、適切なクエリ最適化技法を理解し適用することが重要です。

BigQueryには、クエリ結果のキャッシュ機能があります。同一のクエリが短時間内に再実行された場合、前回の結果がキャッシュから返されるため、処理時間とコストを大幅に削減できます。このキャッシュは24時間保持され、デフォルトで有効になっています。ただし、データの鮮度が重要な場合は、キャッシュを無効にすることも可能です。

一方、ドライランは、クエリを実際に実行せずに、処理されるデータ量を推定する機能です。これにより、クエリの実行前にコストを見積もることができます。BigQueryのコストはプロセス済みバイト数に基づいて計算されるため、ドライランは予算管理のための重要なツールとなります。

キャッシュとドライランを適切に活用することで、BigQueryの運用をより効率的かつ経済的に行うことができます。例えば、開発段階でのクエリテストにはキャッシュを活用し、本番環境での重要な分析ではキャッシュを無効にするといった使い分けが可能です。また、大規模なデータ処理を行う前にドライランを実行し、予想外のコスト発生を防ぐことができます。

パラメータ化クエリは、BigQueryの強力な機能の一つです。これにより、クエリの一部を変数として定義し、実行時に値を指定することができます。パラメータ化クエリを使用することで、クエリの再利用性が高まり、動的なクエリ生成が容易になります。

例えば、日付範囲を指定してデータを抽出するクエリがあるとします。この日付をパラメータ化することで、同じクエリ構造を維持したまま、異なる日付範囲で繰り返し実行することができます。これにより、クエリの管理が容易になり、誤入力のリスクも減少します。

パラメータ化クエリは、セキュリティの観点からも重要です。SQLインジェクション攻撃のリスクを軽減し、よりセキュアなアプリケーション開発を可能にします。また、クエリのパフォーマンス最適化の観点からも有用で、クエリプランのキャッシュを効果的に活用できます。BigQueryを本格的に活用する上で、パラメータ化クエリの使用は必須のスキルと言えるでしょう。

BigQueryのストレージ料金は、保存されているデータ量に基づいて計算されます。料金は、アクティブストレージと長期保存ストレージの2種類に分かれています。アクティブストレージは、直近90日以内に変更またはストリーミング挿入されたデータを指し、長期保存ストレージは90日以上変更されていないデータを指します。

2024年7月現在、アクティブストレージの料金は1TBあたり月額約20ドル、長期保存ストレージは約10ドルとなっています。この料金体系により、頻繁に使用されないデータのコストを抑えることができます。ただし、これらの料金は地域によって若干異なる場合があります。

ストレージコストを最適化するためには、不要なデータの削除や、パーティショニングの活用が効果的です。例えば、日付でパーティショニングしたテーブルを作成し、古いパーティションを定期的に削除することで、ストレージコストを抑えつつ、必要なデータへの高速アクセスを維持することができます。

BigQueryのコンピュート料金は、クエリによって処理されたデータ量に基づいて計算されます。2024年7月現在、1TBあたり約5ドルの料金が設定されています。この料金体系では、クエリの効率性が直接コストに影響します。つまり、同じ結果を得るためにより少ないデータを処理するクエリを書くことで、コストを削減できます。

BigQueryには、オンデマンド料金と定額料金の2つの価格モデルがあります。オンデマンド料金は、使用した分だけ支払う方式で、変動的な使用パターンに適しています。一方、定額料金は、一定のスロットを予約する方式で、大規模で安定した使用パターンに適しています。

コンピュート料金を最適化するためには、クエリの最適化が重要です。例えば、必要な列のみを選択する、適切なフィルタリングを行う、効率的なジョインを使用するなどの方法があります。また、マテリアライズド・ビューを活用することで、頻繁に実行される複雑なクエリのコストを大幅に削減することも可能です。

BigQueryは、一定の無料枠を提供しています。2024年7月現在、毎月10GBのストレージと1TBのクエリ処理が無料で利用できます。この無料枠は、小規模なプロジェクトや学習目的での利用に適しています。無料枠を超えた使用分に対しては、従量課金が適用されます。

従量課金制度により、ユーザーは使用した分だけ支払えばよく、初期投資や最低利用料金などの縛りがありません。これにより、ビジネスの成長に合わせて柔軟にスケールアップすることが可能です。ただし、予期せぬ高額請求を避けるためには、適切な予算管理と監視が必要です。

BigQueryには、予算超過を防ぐためのクォータ設定機能があります。例えば、1日あたりのクエリ処理量に上限を設定することができます。また、前述のドライラン機能を活用して、大規模なクエリの実行前にコストを見積もることも重要です。これらの機能を適切に利用することで、コストを予測可能な範囲に抑えつつ、BigQueryの強力な機能を最大限に活用することができます。

BigQueryはGoogle Cloud Storageと緊密に連携しており、この組み合わせにより大規模なデータ分析パイプラインを効率的に構築できます。Cloud Storageは、構造化・非構造化データを問わず、あらゆる種類のデータを保存できる高度なオブジェクトストレージサービスです。BigQueryとCloud Storageを連携させることで、データの保存と分析を seamlessに行うことが可能になります。

例えば、大量のログファイルをCloud Storageに保存し、BigQueryの外部テーブル機能を使ってそのデータを直接クエリすることができます。これにより、データを移動させることなく分析が可能になり、ストレージコストとデータ転送時間を削減できます。また、BigQueryのクエリ結果をCloud Storageにエクスポートすることも可能で、他のシステムとのデータ連携にも活用できます。

さらに、Cloud Storageを中間ステージとして利用することで、大規模なデータのバッチロードも効率的に行えます。例えば、オンプレミスのデータをまずCloud Storageにアップロードし、そこからBigQueryにロードするという流れです。この方法は、ネットワークの切断などのリスクを軽減し、より確実なデータ転送を実現します。

BigQueryは、GoogleのマネージドリレーショナルデータベースサービスであるCloud SQLやCloud Spannerとも連携が可能です。これらのサービスは、トランザクション処理に特化しているため、BigQueryとの組み合わせによりOLTP(オンライントランザクション処理)とOLAP(オンライン分析処理)の両方をカバーする総合的なデータ基盤を構築できます。

例えば、日々の取引データをCloud SQLで管理し、定期的にBigQueryに転送して大規模な分析を行うといった使い方が考えられます。BigQueryは外部データソース連携機能を持っているため、Cloud SQLやCloud Spannerのデータを直接クエリすることも可能です。これにより、リアルタイムに近い形でトランザクションデータの分析が行えます。

また、BigQueryのクエリ結果をCloud SQLやCloud Spannerに書き戻すこともできます。例えば、BigQueryで複雑な集計や機械学習モデルによる予測を行い、その結果をCloud SQLに保存して高速な参照を可能にするといった使い方です。このように、各サービスの特性を活かした柔軟なデータ活用が実現できます。

Google Cloud Pub/Subは、メッセージングサービスであり、BigQueryとの連携により、リアルタイムデータ分析パイプラインを構築できます。Pub/Subは、大量のイベントデータを高速かつ信頼性高く伝達する能力を持っており、BigQueryのストリーミング挿入機能と組み合わせることで、リアルタイムデータ処理を実現します。

典型的なユースケースとしては、IoTデバイスからのセンサーデータや、ウェブサイトのクリックストリームデータなどをPub/Subで受け取り、BigQueryにストリーミング挿入するというものがあります。これにより、データが生成されてから数秒以内に分析可能な状態になります。BigQueryのストリーミングバッファを活用することで、大量のデータを効率的に取り込むことができます。

さらに、BigQueryのクエリ結果をPub/Subに発行することも可能です。例えば、異常検知のロジックをBigQueryで実装し、異常が検出された場合にPub/Subを通じてアラートを発行するといった使い方ができます。このように、Pub/SubとBigQueryの連携により、リアルタイムデータ処理と分析の両方を兼ね備えた高度なデータパイプラインを構築することが可能となります。

Google Cloud Identity and Access Management (IAM) は、BigQueryのセキュリティを管理する上で中心的な役割を果たします。IAMを使用することで、誰が何をできるかを細かく制御できます。例えば、特定のユーザーに対して、データの読み取りのみを許可し、書き込みや削除は禁止するといった設定が可能です。

BigQueryでは、プロジェクト、データセット、テーブルの各レベルでIAMポリシーを設定できます。これにより、組織の階層構造やデータの重要度に応じた柔軟なアクセス制御が可能になります。例えば、マーケティング部門には売上データへの読み取りアクセスのみを許可し、財務部門にはフルアクセスを与えるといった具合です。

また、IAMには事前定義されたロールが用意されており、一般的なユースケースに対応しています。例えば、「BigQuery閲覧者」「BigQueryデータ編集者」「BigQuery管理者」などです。これらの事前定義ロールを使用することで、セキュリティ設定の負担を軽減できます。さらに、カスタムロールを作成することも可能で、組織固有の要件に応じたきめ細かいアクセス制御を実現できます。

BigQueryは、列レベルおよび行レベルのセキュリティ機能を提供しており、これによりデータのきめ細かな保護が可能になります。列レベルのセキュリティでは、特定の列へのアクセスを制限することができます。例えば、個人情報を含む列へのアクセスを特定のユーザーグループのみに制限するといった使い方ができます。

一方、行レベルのセキュリティでは、条件に基づいて特定の行へのアクセスを制御できます。例えば、営業担当者が自分の担当地域のデータのみにアクセスできるようにするといった設定が可能です。これらの機能を使用することで、同じテーブル内でもユーザーごとに異なるデータビューを提供できます。

これらのセキュリティ機能は、ポリシータグと呼ばれる仕組みを使って実装されます。ポリシータグを列や行に適用し、そのタグに対するアクセス権限をIAMで管理することで、柔軟かつ強力なデータ保護を実現できます。この機能により、データのセキュリティを確保しつつ、必要な情報へのアクセスを効率的に提供することが可能になります。

BigQueryでは、保存されているすべてのデータがデフォルトで暗号化されます。この暗号化は、Google管理の暗号鍵を使用して自動的に行われるため、ユーザーは特別な設定を行う必要がありません。これにより、データの機密性が高いレベルで保護されます。

さらに高度なセキュリティ要件がある場合、顧客管理の暗号鍵(Customer-Managed Encryption Keys, CMEK)を使用することができます。CMEKを使用すると、暗号化に使用する鍵を自社で管理できるようになります。これにより、鍵の回転や削除といった操作を自社のポリシーに基づいて行うことが可能になります。

CMEKの使用には、Google Cloud Key Management Service (KMS) との連携が必要です。KMSで生成した鍵をBigQueryのデータセットに関連付けることで、そのデータセット内のすべてのデータがCMEKで暗号化されます。この機能は、特に金融業界や医療業界など、厳格なコンプライアンス要件がある業界で重要です。CMEKを使用することで、データの暗号化に関する完全な制御を得ることができ、セキュリティとコンプライアンスの両面でより高度な要件に対応することが可能になります。

BigQueryは、高い可用性と耐久性を実現するために、データの自動複製を行っています。デフォルトでは、すべてのデータが地理的に分散した複数のデータセンターに冗長的に保存されます。これにより、単一のデータセンターで障害が発生した場合でも、データの可用性が維持されます。

また、BigQueryは自動的にスナップショットバックアップを作成します。これらのスナップショットは7日間保持され、誤ってデータを削除した場合などに復元が可能です。ただし、この機能はデータの完全な保護を保証するものではないため、重要なデータに関しては追加のバックアップ戦略を検討する必要があります。

さらに、ユーザーが明示的にバックアップを作成することも可能です。例えば、テーブルのコピーを作成したり、データをCloud Storageにエクスポートしたりすることで、より長期的なバックアップを実現できます。これらの機能を組み合わせることで、データの安全性をさらに高めることができます。

BigQueryのタイムトラベル機能は、過去7日間のデータ状態にアクセスできる強力な機能です。この機能により、誤ってデータを削除したり、不適切な更新を行ったりした場合でも、簡単に元の状態に戻すことができます。タイムトラベルは、データの復元だけでなく、時系列分析にも活用できる有用な機能です。

タイムトラベルを使用するには、SQLクエリでTIMESTAMP句を指定します。例えば、「2日前の午後3時のデータ状態を参照する」といったクエリが可能です。この機能は、データの変更履歴を追跡したり、特定の時点のスナップショットを取得したりする際に非常に便利です。

ただし、タイムトラベル機能はストレージコストに影響を与える点に注意が必要です。過去7日間のデータ状態を保持するため、ストレージ使用量が増加します。そのため、コストとデータの重要性のバランスを考慮しながら、この機能を活用することが重要です。

BigQueryは、Googleのグローバルインフラストラクチャを活用して、高度なフェイルセーフ機能と災害対策を提供しています。データは常に複数の地理的に分散したロケーションに保存されるため、単一の障害点がなく、高い信頼性を確保しています。

さらに、BigQueryは自動的にフェイルオーバーを実行します。例えば、あるデータセンターで障害が発生した場合、自動的に他のデータセンターにトラフィックが切り替わります。この過程はユーザーに対して透過的に行われ、サービスの中断を最小限に抑えます。

大規模な災害に備えて、地域をまたいだデータのレプリケーションも可能です。例えば、米国のデータをヨーロッパにレプリケートするといった設定ができます。これにより、地域全体が影響を受けるような大規模災害が発生した場合でも、データの可用性を維持することができます。ただし、このような高度な災害対策を実施する場合は、データの主権やプライバシー法制の問題を考慮する必要があります。BigQueryのこれらの機能を適切に活用することで、ビジネスクリティカルなデータの保護と継続性を確保することができます。

BigQueryからCloud Storageへのデータエクスポートは、大規模なデータセットを効率的に移動させる方法として広く利用されています。このプロセスは、BigQueryコンソール、コマンドラインインターフェース(CLI)、またはAPIを通じて実行できます。エクスポートされたデータは、CSV、JSON、Avro、Parquetなど、様々な形式で保存することが可能です。

例えば、クエリ結果を長期保存したい場合や、他のシステムでデータを利用したい場合に、Cloud Storageへのエクスポートが有効です。エクスポートジョブは非同期で実行されるため、大規模なデータセットでも効率的に処理できます。また、エクスポート先のCloud Storageバケットを適切に設定することで、データの地理的な配置やアクセス制御を細かく管理することができます。

ただし、エクスポート時には一定の制限があることに注意が必要です。例えば、単一のエクスポートジョブで処理できるデータ量に上限があります。大規模なデータセットをエクスポートする場合は、データを適切に分割してエクスポートするなどの工夫が必要になることがあります。BigQueryとCloud Storageの連携を上手く活用することで、柔軟なデータ管理と分析が可能になります。

BigQueryからローカルPCへのデータダウンロードは、小規模なデータセットや迅速なデータ確認が必要な場合に便利な機能です。BigQueryコンソールを使用すると、クエリ結果を直接CSVやJSONファイルとしてダウンロードすることができます。また、Google SheetsやMicrosoft Excelなどの表計算ソフトにデータを直接エクスポートする機能も用意されています。

ただし、ローカルPCへのダウンロードには制限があります。例えば、コンソールからダウンロードできるデータ量には上限があり、通常は数GBまでとなっています。また、大量のデータをローカルPCにダウンロードすることは、ネットワーク帯域やストレージの観点から効率的ではない場合があります。

セキュリティの観点からも、センシティブなデータをローカルPCにダウンロードする際には注意が必要です。組織のデータ保護ポリシーに従い、適切なセキュリティ対策(暗号化、アクセス制限など)を講じる必要があります。大規模なデータセットや頻繁なデータ転送が必要な場合は、Cloud Storageを経由したエクスポートや、専用のデータ転送ツールの利用を検討するべきでしょう。

BigQueryのパーティショニングとクラスタリングは、クエリパフォーマンスを大幅に向上させる重要な機能です。パーティショニングは、特定のカラム(通常は日付やタイムスタンプ)に基づいてデータを物理的に分割します。これにより、クエリが必要なデータのみをスキャンし、不要なデータの読み取りを避けることができます。例えば、過去30日分のデータのみを分析する場合、パーティショニングされたテーブルでは該当する30日分のパーティションのみが処理されます。

一方、クラスタリングは、指定したカラムの値に基づいてデータを並べ替えて保存する機能です。これにより、特定の条件に基づくデータの検索や集計が高速化されます。例えば、顧客IDでクラスタリングされたテーブルでは、特定の顧客に関するデータを効率的に取得できます。パーティショニングとクラスタリングを組み合わせることで、さらに高度なパフォーマンス最適化が可能になります。

ただし、パーティショニングとクラスタリングの設計には注意が必要です。適切なカラムの選択、パーティションの粒度、クラスタリングの順序などを、実際のクエリパターンに基づいて慎重に検討する必要があります。また、これらの機能はストレージコストにも影響を与える可能性があるため、パフォーマンスとコストのバランスを考慮することが重要です。

BigQueryのSearch Index機能は、特定のカラムに対する検索処理を大幅に高速化します。この機能は、主に文字列データに対する部分一致や前方一致などの検索操作に効果を発揮します。Search Indexを利用することで、従来のフルスキャンによる検索と比較して、クエリの実行時間とコストを大幅に削減できます。

例えば、商品名や顧客名といった文字列データに対して頻繁に検索を行うユースケースでは、Search Indexの活用が有効です。インデックスを作成することで、「特定の文字列を含む行を高速に抽出する」といった操作が効率化されます。これは特に、大規模なデータセットに対して部分一致検索を行う場合に顕著な効果を発揮します。

ただし、Search Indexの利用にはいくつかの考慮点があります。インデックスの作成と維持にはコストがかかるため、頻繁に使用される検索パターンに対してのみ適用するべきです。また、インデックスの更新はバックグラウンドで非同期に行われるため、最新のデータが即座にインデックスに反映されない場合があることに注意が必要です。Search Indexを適切に活用することで、BigQueryの検索性能を大幅に向上させ、より効率的なデータ分析を実現できます。

BigQuery Data Transfer Serviceは、様々なソースからBigQueryへのデータ転送を自動化するサービスです。このサービスを利用することで、Google AnalyticsやGoogle Ads、YouTubeなどのGoogleサービスからのデータ転送はもちろん、Amazon S3やTeradata、Oracleなどの外部ソースからのデータ転送も効率的に行うことができます。

Data Transfer Serviceの主な利点は、データ転送プロセスの自動化にあります。定期的なスケジュールを設定することで、データの更新を自動的に行うことができます。これにより、手動でのデータ更新作業が不要になり、常に最新のデータを分析に利用できるようになります。また、転送プロセスの監視やエラー通知機能も提供されており、データ転送の信頼性を高めることができます。

ただし、Data Transfer Serviceの利用には一定の制約があることに注意が必要です。例えば、転送可能なデータ量や転送頻度に制限がある場合があります。また、すべてのデータソースがサポートされているわけではないため、利用前に対象のデータソースがサポートされているかを確認する必要があります。Data Transfer Serviceを適切に活用することで、効率的で信頼性の高いデータパイプラインを構築することが可能になります。

BigQueryのスケジュールされたクエリ機能は、定期的なデータ処理や更新を自動化する強力なツールです。この機能を使用することで、特定のSQLクエリを指定した間隔で自動的に実行し、その結果を新しいテーブルに書き込んだり、既存のテーブルを更新したりすることができます。これは、日次の集計処理や週次のレポート生成など、繰り返し行われるデータ処理タスクに特に有効です。

スケジュールされたクエリの利点は、人間の介入なしに定期的なデータ処理を実行できることです。例えば、毎日午前2時に前日のデータを集計し、集計テーブルを更新するといったタスクを自動化できます。これにより、データアナリストやエンジニアは、繰り返しの作業から解放され、より価値の高い分析や開発に集中することができます。

ただし、スケジュールされたクエリを設定する際は、いくつかの点に注意が必要です。まず、クエリの実行時間とコストを考慮し、適切なスケジュール間隔を設定する必要があります。また、クエリが失敗した場合の対応策(再試行設定やアラート通知など)も検討すべきです。さらに、スケジュールされたクエリの結果によって更新されるテーブルへのアクセス権限管理も重要です。これらの点に注意しながらスケジュールされたクエリを活用することで、効率的かつ信頼性の高いデータパイプラインを構築することができます。

Dataformは、BigQueryを中心としたデータウェアハウスの開発と管理を効率化するためのツールです。SQLベースのワークフロー管理とバージョン管理を組み合わせることで、複雑なデータ変換処理やETL(Extract, Transform, Load)プロセスを効率的に実装し、管理することができます。

Dataformの主な特徴は、SQLをベースとしたデータ定義言語(SQLX)を使用することです。これにより、データエンジニアやアナリストは、慣れ親しんだSQLの知識を活かしながら、より高度なデータパイプラインを構築することができます。また、依存関係の自動管理機能により、複雑なデータ変換の順序を正確に制御することが可能です。

さらに、Dataformはバージョン管理システム(Git)との統合を提供しており、データパイプラインの変更履歴を追跡し、チーム間での協力を促進することができます。これは特に、大規模なデータプロジェクトや複数のチームが関わるプロジェクトで重要です。テスト機能も備えており、データ品質の確保や、変更による影響の事前確認が可能です。

ただし、Dataformの導入には一定の学習コストがかかることに注意が必要です。SQLXの文法や、Dataformの概念(アサーション、ドキュメンテーションなど)を理解する必要があります。また、既存のETLプロセスをDataformに移行する際には、慎重な計画と段階的なアプローチが求められます。Dataformを適切に活用することで、より管理しやすく、スケーラブルなデータパイプラインを構築することが可能になり、データ駆動型の意思決定をより効果的にサポートすることができます。

エンジニア、PM、デザイナーの副業・転職採用サービス「Offers(オファーズ)」では、非公開求人を含む豊富なIT・Web業界の転職・副業情報を提供しています。高年収の求人・高時給の案件や最新技術スタックを扱う企業など、あなたのスキルを最大限に活かせるポジションが見つかります。専任のキャリアアドバイザーが、入社日調整や条件交渉をきめ細かくサポート。転職・正社員求人、副業・業務委託案件、募集をお探しの方はOffersまでご相談ください。閉じる

アーカイブ公開中

昨今、バックエンドにTypeScriptを導入する事例は一般的になり、フロントエンドとバックエンドで型を共有することで開発効率を高めるさまざまなソリューションが登場しています。中でも「RPC(Remote Procedure Call)」を活用したアプローチは注目を集めており、tRPC・oRPC・Hono RPCなど複数の選択肢が存在します。 一方で、「そもそもRPCとは何か」「tRPC・oRPC・Hono RPCはそれぞれ何が違うのか」といった基本的な部分から整理したいと感じている方も多いのではないでしょうか。名前は聞いたことがあるけれど違いがわからない、どれを選べばいいのか判断がつかない、という声も少なくありません。 そこで本イベントでは、tRPCを実務で導入・運用されている海老原氏、oRPCやElysiaを活用されている柿氏、Hono RPCでマルチクライアント対応を実践されているよだか氏の3名をお迎えし、RPCの基本から各ソリューションの特徴・選定の考え方までを紐解きます。 前半のLTでは、柿氏、海老原氏、よだか氏の3名にそれぞれの視点からお話しいただきます。 後半のディスカッションでは、3名を交え、各RPCの推しポイントや課題、モバイル・Webの対応可能性を見据えた技術選定など、現場目線でさらに深掘りしていきます。 RPCという概念自体をこれから理解したい方から、すでに使っていて他の選択肢と比較したい方まで、幅広いエンジニアのご参加をお待ちしています。

開催日:

2026年4月23日(木)19:00~20:30

アーカイブ公開中

昨今、Next.jsの急速な進化に伴い、そのブラックボックス的な実装に疑問を感じ、新たな選択肢を模索するエンジニアの声が増え始めています。そうした中、TanStack Queryをはじめとする「TanStack系ライブラリ」や、新たなフルスタックフレームワーク「TanStack Start」への注目が高まっています。 しかし、実際の運用において「Next.jsと比べて何がどこまで変わるのか」「TanStack系ライブラリを採用する具体的なメリットは何か」を明確にイメージできている方はまだ少ないのが現状です。 そこで本イベントでは、TanStack QueryやTanStack Routerを実務で活用されている寺嶋氏と、TanStack Startをプロダクション環境で実際に採用されている池内氏をお迎えし、Next.js経験者の視点からTanStack系ライブラリ・TanStack Startの実際を紐解きます。 前半のLTでは、まず寺嶋氏よりTanStack Startの全体像やViteエコシステムにおけるポジション、Next.jsとの比較を交えた概要を解説いただきます。続いて池内氏より、TanStack Startプロダクトにおける実践的な側面(デプロイ環境、認証基盤、データベース連携など)について、現時点での整備状況をお話しいただきます。 後半のディスカッションでは、お二人を交え、チーム開発での採用やAIコーディングとの親和性など、現場目線でさらに深掘りしていきます。 TanStackが気になり始めた方から、Next.jsからの移行を検討されている方まで、幅広いエンジニアのご参加をお待ちしています。

開催日:

2026年4月9日(木)19:00~20:00

アーカイブ公開中

パフォーマンス・チューニングは、Webサービスの成長とともに避けて通れないテーマです。中でも「キャッシュ」は有効な手段の一つですが、設計や運用を誤るとデータ不整合やメンテナンス負荷の増大につながる可能性もあります。 「パフォーマンス・チューニングといえば、まずDBやアプリケーションロジックの改善が語られることが多いが、キャッシュはどのタイミングで検討すべきなのか?」 「実務で触れる機会が少なく、方法論を体系的に理解できていない」 ——こうした悩みの声は、現場のエンジニアから数多く寄せられています。 本イベントでは、『達人が教えるWebパフォーマンスチューニング〜ISUCONから学ぶ高速化の実践〜』にてキャッシュの章を執筆され、ご自身でもキャッシュライブラリを実装されている金子達哉氏をお迎えします。 今回は特別に、Offersの実サービス( https://offers.jp/jobs )を題材とした公開パフォーマンスレビューを実施します。 実際のサービスを見ながら、「キャッシュを使うべき場所・使うべきでない場所」をどのように判断するのか、その検討プロセスを公開でお届けします。 👇ISUCON概要はこちら https://isucon.net/ 👇『達人が教えるWebパフォーマンスチューニング〜ISUCONから学ぶ高速化の実践〜』はこちら https://gihyo.jp/book/2022/978-4-297-12846-3

開催日:

2026年3月24日(火)19:00~20:00

アーカイブ公開中

昨今の開発現場において、Claude CodeをはじめとするAIコーディングエージェントの利用は急速に普及しています。一方で、進化のスピードが非常に速く、「全ての機能を把握し、実戦レベルで使いこなす」ことに壁を感じているエンジニアの方も少なくありません。 そうした中、Anthropic主催のハッカソンでも活用された「everything-claude-code」リポジトリがSNS上で大きな話題となりました。Claude Codeのベストプラクティスが網羅的にまとめられた注目のリソースですが、一定の前提知識がないと読み解くのが難しい側面もあります。 そこで、本イベントでは、RevenueCat Shipaton 2025に入賞し、Claude Codeの機能検証・解説を精力的に発信されているOikon氏をお迎えし、「everything-claude-code」を題材にClaude Codeの基本機能と実践的な活用法を紐解きます。 前半では、Claude Codeの基本機能を押さえたうえで「everything-claude-code」の全体像について解説します。 後半のディスカッションでは、実際の画面をご覧いただきながら「everything-claude-code」リポジトリを参照し、手元の環境でいくつかのコードを動かすデモを通じて、より具体的な活用法を深ぼっていきます。 Claude Codeを触り始めたばかりの方から、もっと使いこなしたい方まで、幅広いエンジニアのご参加をお待ちしています。 ↓「everything-claude-code」リポジトリはこちら https://github.com/affaan-m/everything-claude-code

開催日:

2026年3月17日(火)12:00~13:00

アーカイブ公開中

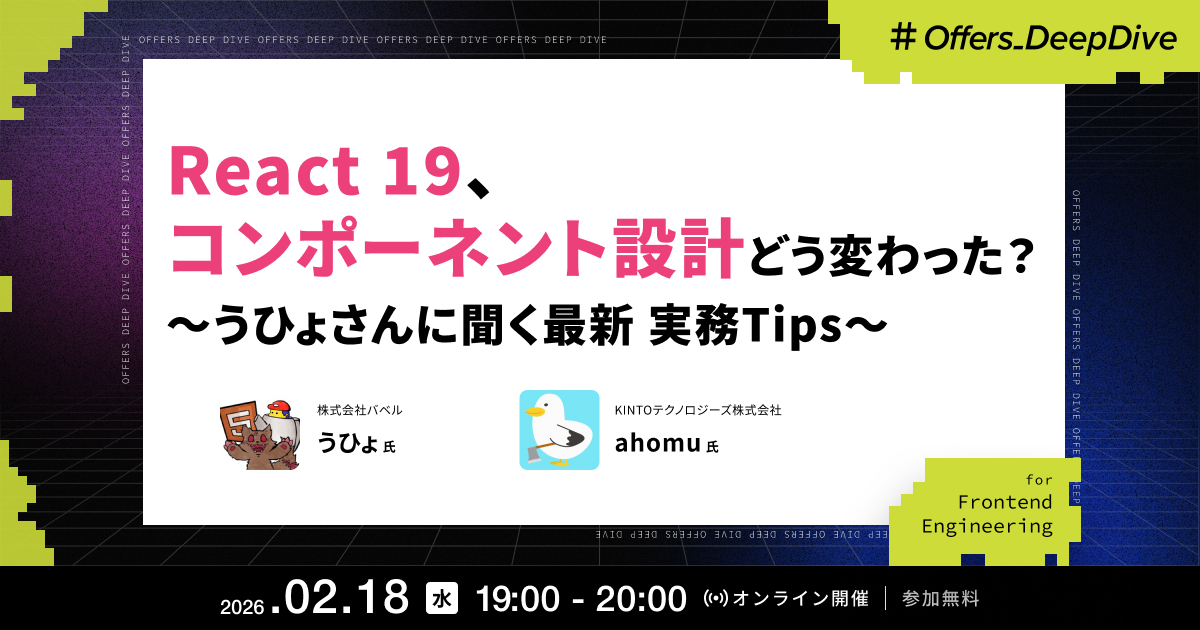

前回「LT&ディスカッション5ラウンド!うひょさん・よしこさんと改めて考えるReactコンポーネント設計」( https://offers.connpass.com/event/298939/ )のイベント開催から約2年が経過し、その間にReactやNext.jsは大きく進化してきました。Server ComponentsやSuspense、新しい非同期処理のAPIの登場などにより、パフォーマンスや表現力は向上した一方で、コンポーネント設計は以前にも増して複雑になりやすい状況になっています。 またAIの登場により、設計部分の重要性は、以前にも増して高まっていると感じており、AIライクとヒューマンライクのどちらに寄せるべきなのかの判断も難しいと感じている方も多いのではないでしょうか。 そこで本イベントでは、うひょ氏をお招きし、「今、現場で採用すべきコンポーネント設計のベストプラクティス」を実務経験をもとに解説していただきます。 迷いなく設計判断ができるようになるための指針を、持ち帰れるイベントです。ぜひご参加ください。

開催日:

2026年2月18日(水)19:00~20:00